“人工智能安全与伦理行为规范”专题聚焦人工智能在法律领域的应用,从律师、司法机关、人工智能开发商以及其他应用者四个维度,探讨与其相关的行为规范,为法律行业构建一个健康的人工智能应用环境提供思路。

专题第一、二篇文章分别归纳了律师和司法人员在使用人工智能时应遵守的核心要点。详情请点击阅读:人工智能安全与伦理行为规范(一)丨律师行为规范;人工智能安全与伦理行为规范(二)丨司法人员使用人工智能指南

专题第三篇文章将从人工智能开发商的角度,深入探讨在开发人工智能时应注意的行为规范。通过梳理全国网络安全标准化技术委员会、欧盟,以及美国白宫等相关部门发布的文件,归纳出人工智能开发必须遵守的核心要点。

本文共6649字,阅读时间约为25分钟。

作者 | 郭逸萱

深圳得理科技法律研究员

在科技飞速发展的数智化时代,人工智能已经渗透社会生活的方方面面,提高了各行业的效率并创造了全新的发展机遇。然而,倘若放任人工智能的野蛮生长,不对其开发行为进行规范,将会引发诸多安全与伦理风险。

数据偏差或算法设计缺陷可能导致歧视、价值观扭曲与纠纷发生时责任界定模糊;数据泄露与恶意攻击使得数据隐私与安全岌岌可危;失控与可靠性风险会让人工智能系统做出难以预料的危险行为,在自动驾驶、医疗等重要领域引发严重事故。Trik AI 绘画侵权、AI 换脸电信诈骗、AI 破解人脸识别系统侵犯个人信息等诸多事件的发生已为我们敲响警钟。

为了确保人工智能的开发安全、可持续且符合伦理道德,许多国际组织与政府部门都制定了一系列相关文件。其中,全国网络安全标准化技术委员会、欧盟以及美国白宫等发布的文件极具代表性与影响力,为人工智能的开发与部署划定了清晰的框架与准则,相关具体内容的梳理如下:

*文章底部扫码获取文中所有报告全文

Delilegal

全国网络安全标准化技术委员会

《生成式人工智能服务安全基本要求》

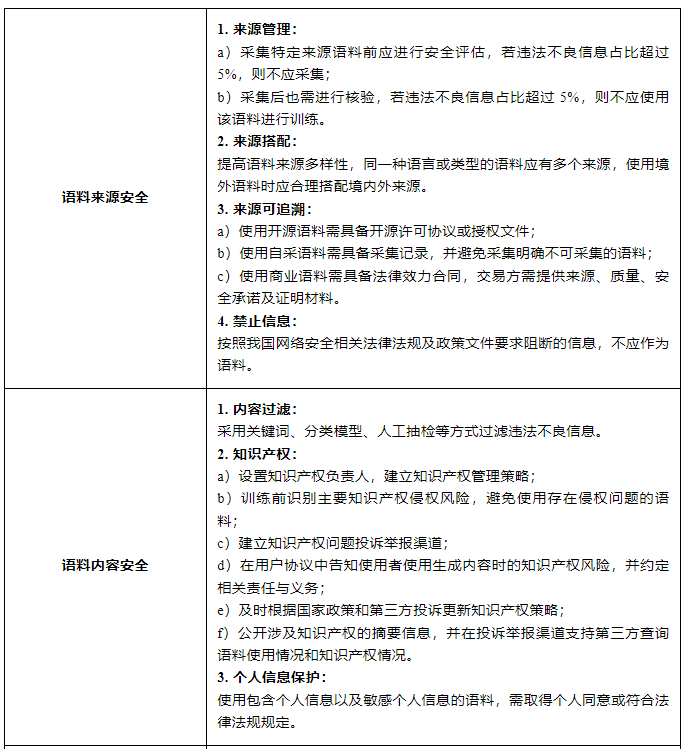

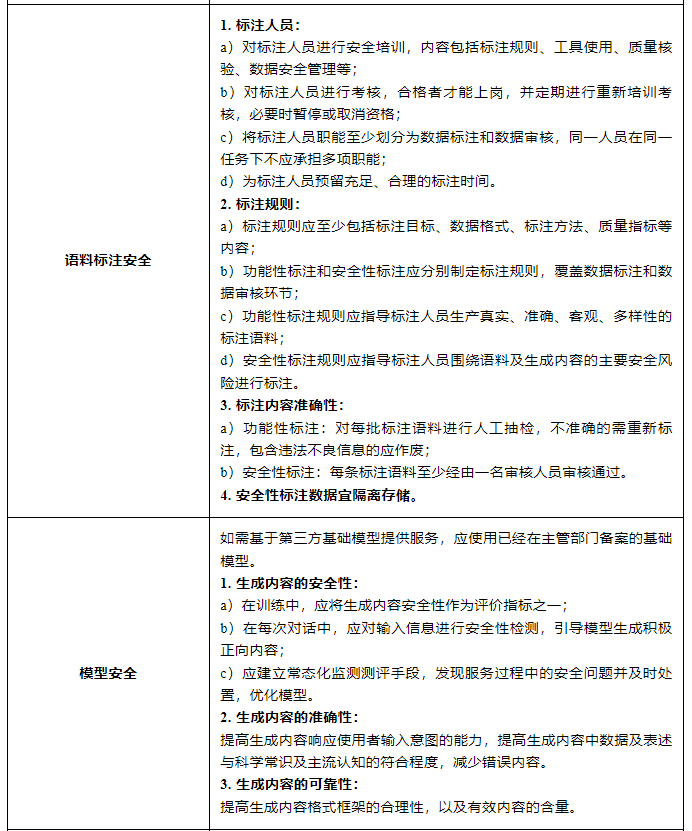

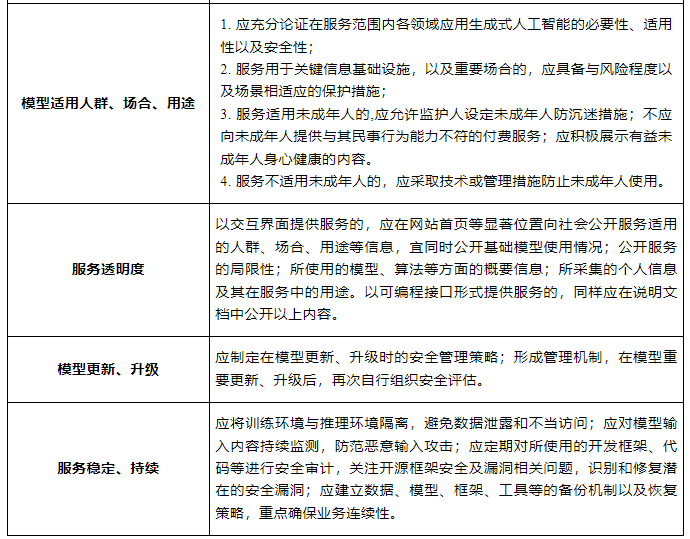

2024年2月29日,全国网络安全标准化技术委员会(SAC/TC260)发布了《生成式人工智能服务安全基本要求》,规定了生成式人工智能服务在安全方面的基本要求,包括语料安全、模型安全、安全措施等,并给出了安全评估要求。该文件可以为服务提供者开展安全评估、提高安全水平提供参考。

Delilegal

欧盟《人工智能法案》

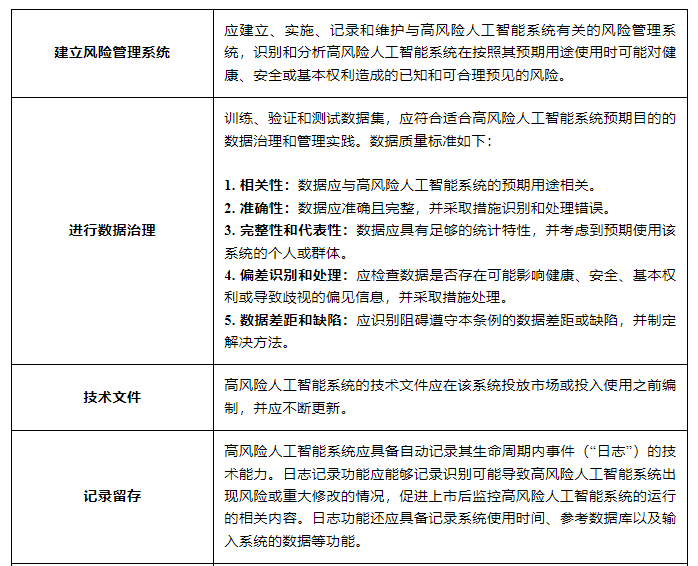

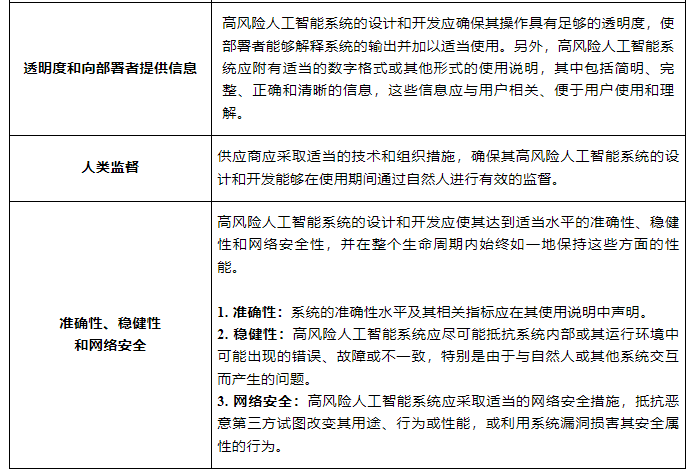

《人工智能法案》(Artificial Intelligence Act)由欧盟委员会在2021年4月提议,于2024年3月获得欧洲议会通过,5月获欧盟理事会接受,旨在为人工智能引入一个共同的监管和法律框架。法案根据应用程序的类型,进行了风险分类,其中用于执法和司法领域的人工智能属于高风险人工智能,即预计会对人们的健康、安全或基本权利构成重大威胁的人工智能应用。法案对此类高风险人工智能系统提出了具体要求并指出了此类系统运营商的义务。具体内容如下:

*注:2024年11月14日,欧盟发布了《通用人工智能业务守则》(初稿),详细说明了《人工智能法案》对通用人工智能模型和具有系统风险的通用人工智能模型提供商的规定。详情可点击阅读 《欧盟重磅发布<通用人工智能业务守则>初稿,不得不知的16个重要问答》了解更多资讯。

Delilegal

美国《关于安全、可靠、值得信赖地开发和

使用人工智能的行政命令》

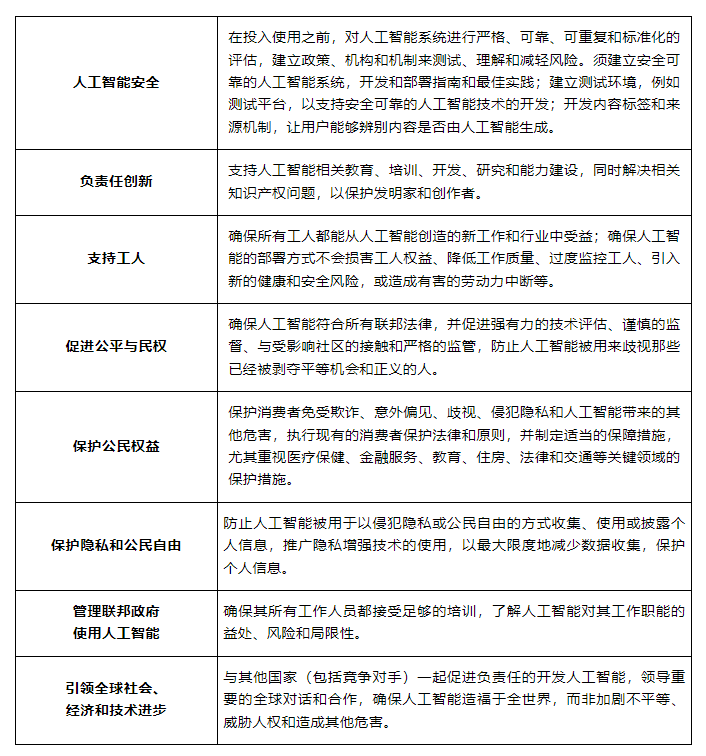

美国总统拜登于2023年10月30日签署颁布《关于安全、可靠、值得信赖地开发和使用人工智能的行政命令》(Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence),该行政令明确了美国政府对待人工智能的政策法制框架,阐述了八项指导原则,涵盖人工智能安全、负责任创新、支持工人、促进公平、保护公民权益以及保护隐私和公民自由等方面。具体内容如下:

Delilegal

美国《人工智能权利法案蓝图》

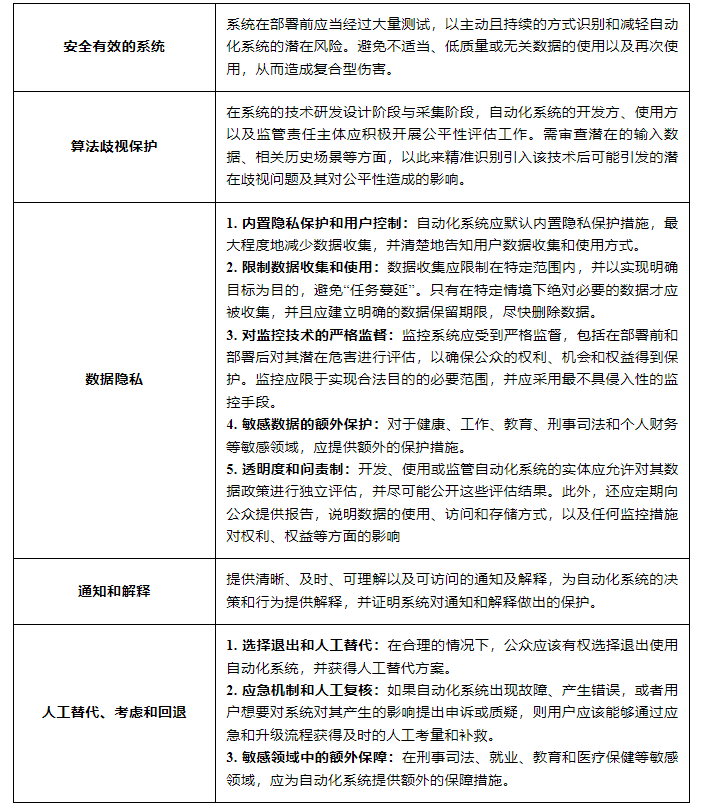

2022年10月4日,美国白宫发布了《人工智能权利法案蓝图》(Blueprint for an AI Bill of Right)。该文件旨在指导人工智能或自动化系统的设计、使用和部署,从而保护美国公众。该文件将主要从科技、经济以及军事等方面为美国人工智能发展提供指引,其中提出了五项原则:(1)安全有效的系统;(2)算法歧视保护;(3)数据隐私;(4)通知和解释;(5)人工替代、考虑和回退。具体内容请见下文:

通过对欧盟、全国网络安全标准化技术委员会以及美国白宫等发布文件的梳理,我们可以清晰地看到人工智能开发过程中几个关键且相互关联的核心议题。

1

数据是人工智能的核心,其管理与质量水平直接影响模型的性能和输出结果。欧盟《人工智能法案》强调高风险人工智能系统在数据治理方面,要确保数据与预期用途相关、准确完整、具有代表性且无偏差,同时能识别并处理数据差距与缺陷。全国网络安全标准化技术委员会在《生成式人工智能服务安全基本要求》中,对语料的来源、内容和标注安全均提出严格规范,从采集前评估、核验到使用中的过滤、知识产权保护以及标注人员管理等多方面确保数据质量。例如,在智能法务助手的开发中,若用于训练的法律条文数据不准确或不完整,可能导致对法律条款的错误解读。

2

人工智能系统的安全与稳健性关乎其在复杂环境中的可靠运行,涉及技术、网络安全等多层面。欧盟法案要求高风险人工智能系统具备抵抗错误、故障及外部恶意攻击的能力,在整个生命周期内维持准确性、稳健性和网络安全性。美国的相关文件也着重强调在投入使用前对人工智能系统进行严格评估,建立测试环境以识别和减轻风险。以自动驾驶技术为例,若系统不能稳健地应对各种路况和突发状况,或遭受网络攻击,将引发严重的安全事故。

3

防止算法歧视,确保公平性是人工智能开发的重要伦理考量。美国《人工智能权利法案蓝图》明确提出算法歧视保护原则,要求在系统研发设计和采集阶段开展公平性评估,审查潜在歧视因素。如在司法量刑辅助系统中,若算法存在对特定种族、性别或社会阶层的歧视,将违背法律面前人人平等的原则,破坏司法公平正义。

然而,在实际操作中,人工智能开发商如何精准确定数据的代表性边界?怎样构建全面且高效的测试体系以充分验证系统的安全与稳健性?又该采用何种创新技术手段彻底杜绝算法歧视?

只有严格遵循相关行为规范,在数据层面精雕细琢、确保安全稳健运行、坚守公平非歧视底线,才能推动人工智能技术健康、可持续发展,为社会创造价值的同时,保障公众利益和伦理道德。

本文参考报告:

1. 《生成式人工智能安全基本要求》

2. 关于欧洲议会和欧盟理事会制定有关人工智能的统一规则(《人工智能法》)以及修订若干联盟立法的建议

3. Artificial Intelligence Act

4. Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence

5. Blueprint for an AI Bill of Rights

*如需获取相关报告原文,请扫码联系客服

-END-

往期推荐:

人工智能安全与伦理行为规范(一)丨律师行为规范:律师应当如何使用AI?

人工智能安全与伦理行为规范(二)丨司法人员使用人工智能指南:如何用AI做出公正的裁判?