“人工智能安全与伦理行为规范”专题聚焦人工智能在法律领域的应用,从律师、司法机关、人工智能开发商以及其他应用者四个维度,探讨与其相关的行为规范,为法律行业构建一个健康的人工智能应用环境提供思路。

专题第一篇文章归纳了律师在使用人工智能时必须遵守的核心要点。详情请点击阅读:系列专题丨人工智能安全与伦理行为规范(一):律师行为规范

专题第二篇文章将带您深入了解司法人员在使用人工智能时应遵守的行为规范。通过梳理最高人民法院、香港司法机构、英国司法机关、加拿大联邦法院以及新西兰法院发布的相关文件,归纳出司法人员在使用人工智能时必须遵守的核心要点。

本文共5296字,阅读时间约为20分钟。

作者 | 郭逸萱

深圳得理科技法律研究员

COMPAS是一款法律案例管理和决策支持系统,在美国地方的司法体系里被广泛应用于预测被告的再犯几率,作为建议量刑的基础。然而,根据一项报道显示,尽管COMPAS的正确预测率超过60%,但黑人更有可能被误判(被预测为高风险却没有再犯),白人则更有可能被漏判(被预测为低风险却再次犯罪)。【注1】

人工智能系统如COMPAS在司法决策中的应用,虽然提高了效率,但其预测结果若存在偏见问题,将严重损害司法公正。因此,为司法人员使用人工智能制定行为规范是确保司法公正、决策准确、强化责任与监督、促进技术发展与完善的重要举措。

司法人员对生成式人工智能工具的使用越来越多,然而对于司法部门的工作人员使用这些工具的指导却很少。本文梳理了国内外司法人员如何在保证安全且符合伦理的方式下使用人工智能工具的相关内容,现有规范的具体内容如下:

*文章底部扫码联系客服即可获取文中的相关报告全文

中华人民共和国最高人民法院

早在2022年12月,为了推动人工智能同司法工作融合,结合人民法院的实际工作,最高人民法院制定了《最高人民法院关于规范和加强人工智能司法应用的意见》,意见提出了司法人员使用人工智能时应遵循的五项原则。

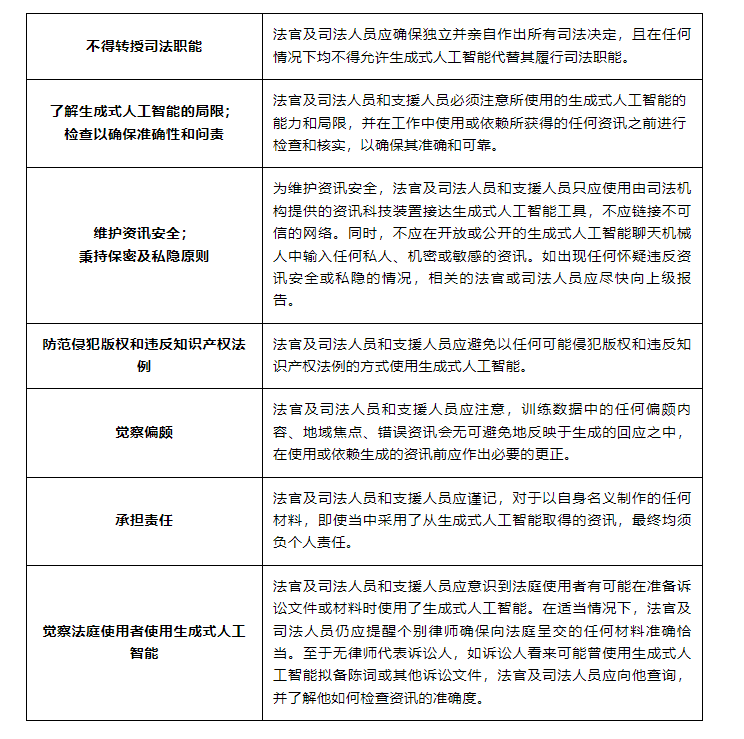

香港司法机构

2024年9月,香港司法机构发布了《香港司法机构法官及司法人员和支援人员使用生成式人工智能的指引》,文件指出相关人员在使用任何人工智能时,都不得将司法职能转授予人工智能;需对人工智能生成的输出结果保持警觉,并承担使用风险。具体内容如下:

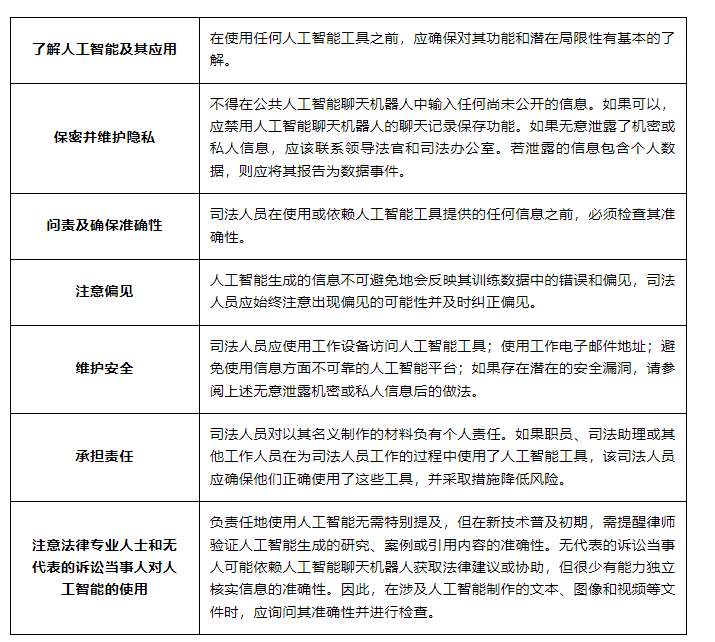

英国司法机关法院与审裁处

2023 年 12 月,英国司法机关法院与审裁处发布了《人工智能–给司法人员的指引》(Artificial Intelligence (AI) - Guidance for Judicial Office Holders),旨在协助司法工作人员使用人工智能,其中强调了保密和维护隐私的重要性,还提到了人工智能工具可能存在偏见及输出信息不准确等问题,司法人员需要对生成内容负责并注意到当事人或代理人可能使用了人工智能工具。

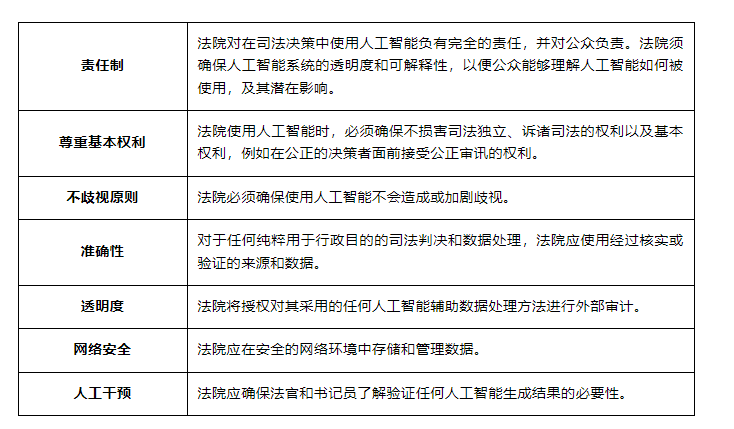

加拿大联邦法院

2023年12月,加拿大联邦法院发布了《关于法院使用人工智能的过渡性原则与指引》(Interim Principles and Guidelines on the Court’s Use of Artificial Intelligence),其核心在于谨慎而负责任地探索人工智能在司法领域的应用。文件列出了指导人工智能使用的七项原则,包括责任制、尊重基本权利、不歧视原则、准确性、透明度、网络安全和人工干预,具体内容如下:

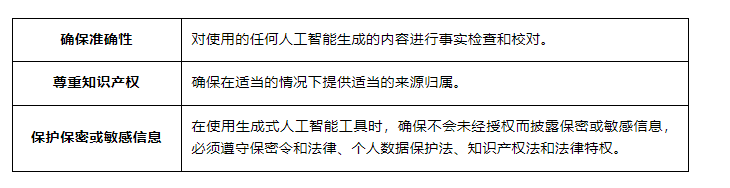

新加坡最高法院

2024年9月,新加坡最高法院、家事法庭、州法院同时发布了《法院用户使用生成人工智能工具指南》(Guide on the Use of Generative Artificial Intelligence Tools by Court Users),指南内容不仅适用于司法人员,还适用于全部诉讼参与人,其总体原则是法院对生成式人工智能持中立态度,不禁止诉讼参与人使用生成式人工智能,但法院用户须对生成的内容承担全部责任。

新西兰法院

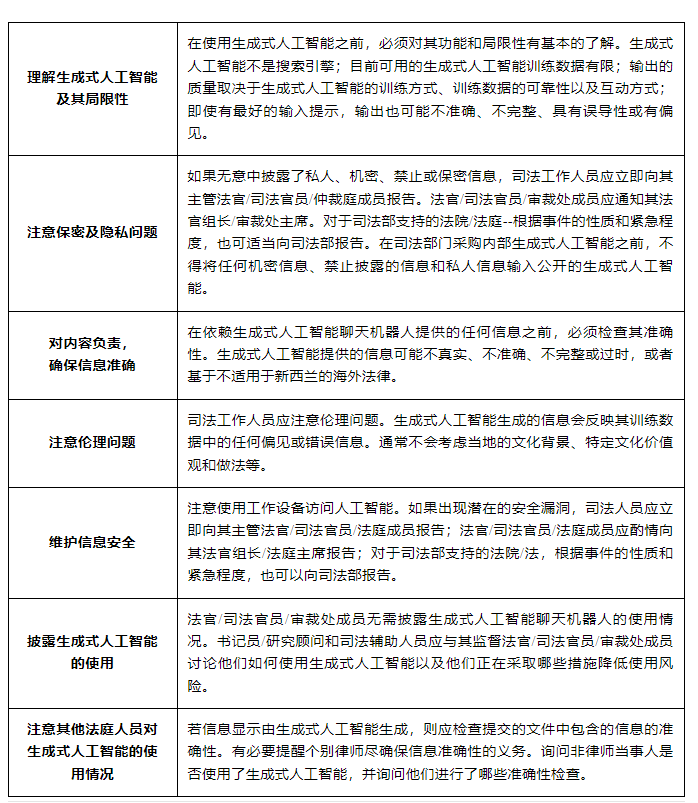

2023年12月,新西兰法院发出《关于法院与审裁处使用生成式人工智能的指引》(Guidelines For Use of Generative Artificial Intelligence in Courts and Tribunals),旨在规范法官、司法人员及相关工作人员使用生成式人工智能(GenAI)工具,例如ChatGPT、Bing Chat和Google Bard。

指南强调了生成式人工智能工具的局限性,例如其可能产生不准确、不完整或有偏见的信息,并且缺乏对新西兰法律和程序的充分了解。因此,指南严格要求使用者核实生成式人工智能提供的信息准确性,并注意保密、隐私和版权问题。指南还列举了生成式人工智能的潜在用途,例如信息总结和执行行政任务,但不适用于法律分析等需要批判性思维的任务。指南的目标是确保在司法程序中负责任地使用生成式人工智能,维护司法公正的完整性。

不同国家和地区的司法体系、法律体系以及法律环境存在显著差异。因此,各司法机构在具体规定上各有不同,但都普遍强调了司法人员在使用人工智能时不得转授司法智能、须对生成内容负责、维护知识产权以及做好信息保密这四个方面。

1. 不得转授司法职能

生成式人工智能基于大数据运作,而无法理解行文内容,更不必说字里行间的微妙差别或语境,因而有可能得出不准确或偏差的结论。人工智能应当用于帮助司法机构更高效地履行其职责,同时不损害司法独立和司法公正。因此,司法人员必须确保人工智能工具的使用只能是辅助作用,司法人员应确保独立且亲自做出司法决定。

2. 对生成内容负责

由于人工智能输出内容的质量与其训练方式、训练数据的可靠度等因素相关,再加上人工智能工具未必会提供来自权威数据库的答案,因而有可能提供编造虚构的案例、引文,或提述不存在的法例,或者提供错误信息。因此,司法人员在使用人工智能提供信息之前必须进行检查和核实,以确保其准确和可靠,为以自身名义制作的任何材料负责。

另外,由于生成式人工智能生成的信息会反映其训练数据中的任何偏见或错误信息,因此司法人员应始终注意出现偏见的可能性并及时纠正。

3. 维护知识产权

将受知识产权保护的出版物上传至人工智能工具以获取摘要或分析等内容,有可能会侵犯作者的版权,同时直接引用摘录内容而不作出标注,亦可能产生版权问题。因此,司法人员应在法庭文件中标注使用或引用的任何资料的来源。

4. 做好信息保密

一些人工智能工具会保留输入的信息,并用以回应其他使用者的提问。司法人员应当避免在此类人工智能工具中输入任何涉及隐私、机密或敏感的信息。如果已经出现或者怀疑出现任何不利于信息保密的情况,应及时向相关上级报告,将不利影响降至最低。

结语

人工智能工具是一把双刃剑,提高司法人员提高工作效率的同时,也可能带来各种风险,如何正确合理地使用人工智能工具尤为重要。司法人员应确保裁决公平争议、保证信息安全、为生成内容负责、避免侵犯知识产权,从而推动人工智能技术在司法领域的健康发展,维护公正、高效、透明的司法体系。

注1:Angwin, J., Larson, J., Mattu, S. & Kirchner, L. (2016). Machine Bias: There’s software used across the country to predict future criminals. And it’s biased against blacks. ProPublica. https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing

本文参考报告:

1. 《最高人民法院关于规范和加强人工智能司法应用的意见》

2. 《香港司法机构法官及司法人员和支援人员使用生成式人工智能的指引》

3. Artificial Intelligence (AI) - Guidance for Judicial Office Holders

4. Interim Principles and Guidelines on the Court’s Use of Artificial Intelligence

5. Guide on the Use of Generative Artificial Intelligence Tools by Court Users

6. Guidelines For Use of Generative Artificial Intelligence in Courts and Tribunals

*如需获取相关报告原文,请扫码联系客服

-END-

往期推荐